Depuis deux ou trois ans, les algorithmes qu’on désigne sous le nom générique d’intelligence artificielle ont atteint une efficacité spectaculaire dans certains domaines qu’on croyait pour un temps encore réservés aux êtres humains : peindre, écrire, composer de la musique, traduire… Leur dernière déclinaison en date, ChatGPT, un chatbot conversationnel mis en ligne en novembre 2022, est sur tous les écrans. Mais que fait-il exactement ?

Jean-Gabriel Ganascia, Servitudes virtuelles. Seuil, coll. « Science ouverte », 320 p., 21 €

Kate Crawford, Contre-Atlas de l’intelligence artificielle. Trad. de l’anglais (Australie) par Laurent Bury. Zulma, 384 p., 23,50 €

Il ne se passe pas un mois sans que trois ou quatre livres soient publiés pour détailler les avantages économiques, les avancées scientifiques, les conséquences sociales et les problèmes éthiques qui pourraient découler de l’utilisation massive de l’intelligence artificielle dans tous les secteurs de la société. À titre d’exemple, l’algorithme Alphafold a prédit les structures moléculaires de deux cents millions de protéines ; DeepMind(1), la compagnie qui l’a conçu, a mis en ligne gratuitement la base de données qu’elle a constituée, ce qui facilite considérablement le travail des chercheurs en biologie et en pharmacologie partout dans le monde. D’un autre côté, des sociétés comme Amazon ou Alibaba font tourner des IA pour ajuster en temps réel les prix de leurs produits en fonction des variations du marché afin de dégager une rentabilité maximale, tandis que d’autres algorithmes calculent comment « optimiser » le temps de travail des employés tout en les payant le moins possible. De fait, les IA sont des outils neutres, et leur existence ne peut faire préjuger de l’usage que l’on en fait, à l’instar d’un marteau qui peut servir à taper sur un clou ou sur la tête de quelqu’un. Pour autant, il n’est pas inutile de se pencher sur les conséquences que l’utilisation généralisée de ces algorithmes peut entraîner.

© CC2.0/Mike MacKenzie/www.vpnsrus.com

L’une des premières qui viennent à l’esprit, c’est l’augmentation du chômage et de la précarité. Et bien sûr, dans le cas de ChatGPT, le chômage et la précarité des plumitifs en tout genre, étant donné que cet algorithme semble à plus ou moins long terme destiné à les remplacer. Le meilleur moyen de juger des performances de ce collègue putatif étant de lui demander un papier, je lui ai soumis la requête suivante :

Écrire un article sur les livres publiés en France sur l’intelligence artificielle en 2022

En 2022, de nombreux livres sur l’intelligence artificielle ont été publiés en France. Ces ouvrages abordent des sujets variés, allant des bases théoriques de l’IA à ses applications dans divers domaines tels que la finance, la santé, la robotique et les jeux.

L’un des livres les plus remarquables de cette année est « IA : les enjeux éthiques et sociaux » de Jean-Gabriel Ganascia. Il explore les implications éthiques de l’IA et les défis auxquels nous sommes confrontés en matière de responsabilité, de transparence et de respect de la vie privée.

« IA : vers un monde plus humain ? » de Cédric Villani. Ce livre aborde les conséquences de l’IA sur l’emploi, la société et la vie privée. Il examine également les risques potentiels de l’IA, tels que la discrimination, la perte de contrôle et les énormes inégalités.

« IA et finance : comprendre les enjeux » d’Alexandre Gramfort et Mathieu Rosenbaum est un autre livre intéressant qui examine les implications de l’IA dans le domaine financier. Il explique comment l’IA est utilisée pour améliorer l’efficacité des marchés financiers et comment elle peut être utilisée pour aider les investisseurs à prendre des décisions éclairées.

En résumé, les livres sur l’IA publiés en France en 2022 offrent une vue d’ensemble sur les développements récents dans le domaine de l’IA, ainsi que les enjeux éthiques et sociaux liés à cette technologie émergente. Il y a des livres pour tous les niveaux de connaissance et pour tous les domaines d’application.

Bon, on est loin du gonzo journalism, mais c’est lisible et structuré. En revanche, j’ai été surpris par la bibliographie proposée, et notamment par le livre de Ganascia, qui vient de publier Servitudes virtuelles, un très bon bouquin qui aborde justement ces questions, en mars 2022. Comme deux livres dans l’année sur le même thème, ça fait quand même beaucoup, je me suis demandé si l’ami ChatGPT n’était pas un peu affabulateur. Je lui ai donc soumis la requête suivante : Apollinaire et Proust ont-ils eu une correspondance ?

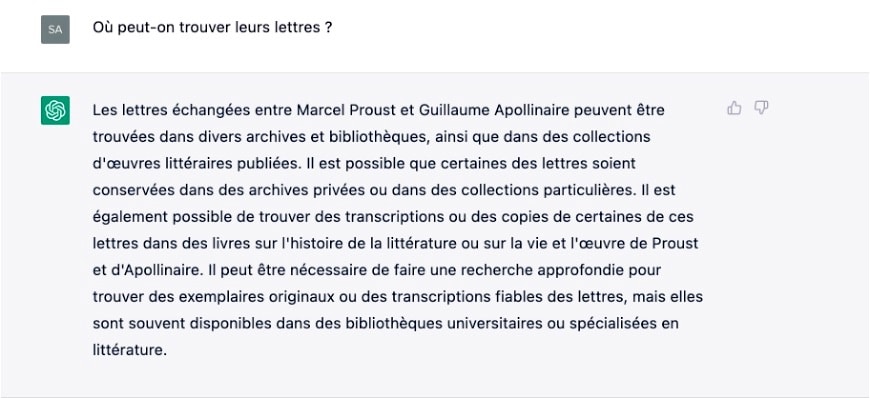

Voici la réponse de ChatGPT.

Très étonnant ! Bien sûr, j’ai insisté.

J’ai poussé la machine dans ses derniers retranchements en lui demandant d’où elle tenait ces informations.

Mais elle n’a rendu les armes que lorsque je lui ai demandé si tout ceci était bien réel.

On remarquera que pour ChatGPT cette correspondance inventée de toutes pièces ne relève que d’une « confusion », et qu’il « semble » qu’il s’est trompé. « Cependant », il a quand même un peu raison. Sauf que là encore, il a tort, parce que Proust et Apollinaire ne fréquentaient pas les mêmes cercles artistiques et littéraires – malgré le « il est bien connu » que, comme tout bonimenteur, il place en début de phrase.

On remarquera que pour ChatGPT cette correspondance inventée de toutes pièces ne relève que d’une « confusion », et qu’il « semble » qu’il s’est trompé. « Cependant », il a quand même un peu raison. Sauf que là encore, il a tort, parce que Proust et Apollinaire ne fréquentaient pas les mêmes cercles artistiques et littéraires – malgré le « il est bien connu » que, comme tout bonimenteur, il place en début de phrase.

On est loin du journalisme. L’idée de fond qui préside à la genèse de ce texte n’est pas la « vérité », avec tout le cortège de précisions et de contextualisations qui nous permettrait de l’admettre ou de la réfuter, mais le « vraisemblable », lequel repose sur l’idée que « ce qui aurait pu se passer » et « ce qui s’est passé » sont deux récits interchangeables. L’invention d’une correspondance entre Proust et Apollinaire, un fait totalement délirant pour quiconque a gardé le moindre contact avec la réalité, est délivrée sous une forme éminemment assertive et avec un aplomb digne, encore une fois, des meilleurs bonimenteurs.

Alors, les matheux d’OpenAI ont-ils fait n’importe quoi ? Non. Car ChatGPT n’est pas un outil factuel, c’est un outil prédictif : quand vous lui posez une question, il tâche de deviner la réponse que vous voudriez entendre et il vous la donne en s’appuyant sur des probabilités. Il a été conçu pour fournir un texte vraisemblable, et non pour délivrer une information fiable. D’ailleurs, ne cherchez pas à lire les trois ouvrages que ChatGPT a mentionnés dans l’article que je lui ai demandé de rédiger : ils n’existent pas, et leur titre ainsi que le bref résumé de leur contenu ne sont que le produit des calculs de l’algorithme.

Certes, il ne serait pas compliqué d’imaginer un chatbot qui serait couplé à un moteur de recherche. Et devant le succès rencontré par ChatGPT, qui a connu la croissance la plus rapide d’une application dans l’histoire d’Internet en réunissant cent millions d’utilisateurs actifs en deux mois, Google vient d’annoncer la mise en ligne prochaine de son propre algorithme – Bard, un nom qui fait bien sûr référence à Shakespeare – et la volonté de le coupler avec son moteur de recherche, parce qu’il redoute les répercussions de cette nouvelle technologie sur son monopole (2).

Pour autant, ce couplage ne résoudrait pas le problème. En effet, un tel duo raconterait moins de bêtises que ChatGPT, mais son savoir ne serait que statistique, parce que pondéré par la masse de données stockées sur Internet. Autant dire que tous les sites qui affirment que la Terre est plate ou que la famille royale britannique est en réalité constituée d’extraterrestres reptiliens qui ont colonisé l’Angleterre il y a plusieurs siècles feront partie du substrat à partir duquel l’algorithme calculera ses réponses.

« Alas, poor Yorick » © CC2.0/Bill Smith/Flickr

Plus grave encore, les fondateurs d’OpenAI ont eux-mêmes publié en 2019 des mises en garde quant au fait que leur technologie pouvait accroitre les risques de désinformation et les théories complotistes (3). Cela fait écho aux thèses développées par Steve Bannon, le conseiller d’extrême droite de Donald Trump qui prescrivait de noyer les médias grand public sous un flot d’informations alternatives afin de créer un « chaos informationnel » qui détruise la faculté de jugement des individus. L’objectif n’est plus de persuader les gens, mais de les désorienter, et les chatbots semblent l’outil rêvé pour y parvenir.

Alors, que peut-on faire face à tout cela ?

En premier lieu, il faut s’informer. Savoir ce que font ces algorithmes et comment ils fonctionnent, repérer les dangers liés à leur diffusion massive, mais aussi les bénéfices qui peuvent résulter de leur utilisation raisonnée. Ensuite, il faut légiférer. Les politiques feraient bien de se pencher sur l’émergence de ces outils et de ne plus se contenter d’une ou deux métaphores mal comprises pour étayer leurs analyses. L’IA, c’est une révolution technologique, au même titre que la roue, la presse d’imprimerie, ou le transistor. L’attitude habituelle des élus consistant à ignorer le problème et à s’enfoncer la tête dans le sable en attendant l’élection suivante risque de ne pas être à la hauteur des enjeux.

Pour finir, il n’est peut-être pas inutile de citer quelques livres qui existent dans la réalité que nous partageons, écrits par des gens qui savent de quoi ils parlent. Citons entre autres Servitudes virtuelles, de Jean-Gabriel Ganascia, déjà mentionné plus haut, qui traite des questions éthiques liées à l’utilisation des IA, et Contre-Atlas de l’intelligence artificielle, de Kate Crawford, qui explique en détail les coûts et l’impact des IA sur nos sociétés pour le seul bénéfice des « géants de la Tech » (chez Zulma Essais, qui a publié beaucoup d’ouvrages essentiels sur ces sujets, dont celui de Shoshana Zuboff, L’âge du capitalisme de surveillance).

Quant aux optimistes, dont je suis, ils peuvent toujours se dire que l’apparition de ces outils conduira les gens à remettre en question ce qu’ils voient et à s’interroger sur ce qui compte vraiment dans une information : sa source.

![Amadou Barry, Journal d’un exilé, Paris, Julliard, 2025, 253 p. Abdoulaye Soumah, avec Thomas-Louis Novillo, Je ne voulais pas partir, Paris, Grasset, 2025, 123 p. Amets Arzallus Antia, Ibrahima Balde, Petit frère. Miñan [2020], tr. de l’espagnol par Roland Béhar, Paris, Payot, coll. « Bibliothèque Rivages », 2024, 203 p. Collectif La Famille Rester. Étranger, Rester. Étranger, Montreuil, B42, coll. « Sentiers », 2024, 208 p. Taina Tervonen, Les veilleurs. Cinq vigies, autour des frontières](https://www.en-attendant-nadeau.fr/wp-content/uploads/2025/03/33677313943_b7d3b5f635_k.jpg)

![Quinn Slobodian, Le Capitalisme de l’apocalypse. Ou le rêve d’un monde sans démocratie, trad. de C. Le Roy, Seuil, 2025 [2023], 368 p., 25,50 € Arnaud Orain, Le Monde confisqué. Essai sur le capitalisme de la finitude (XVIe-XXIe siècle)](https://www.en-attendant-nadeau.fr/wp-content/uploads/2025/01/1920px-Yangshan-Port-Containers.jpg)